导读部分 返回列表

实验编号:EXP-2026-0428-DB实验日期:2026年4月27日-28日实验对象:豆包AI助手(含豆包App、网页版、豆包编程模块)核心假说:豆包在生活场景中能替代至少5类工具App,在工作场...

正文内容

实验编号:EXP-2026-0428-DB

实验日期:2026年4月27日-28日

实验对象:豆包AI助手(含豆包App、网页版、豆包编程模块)

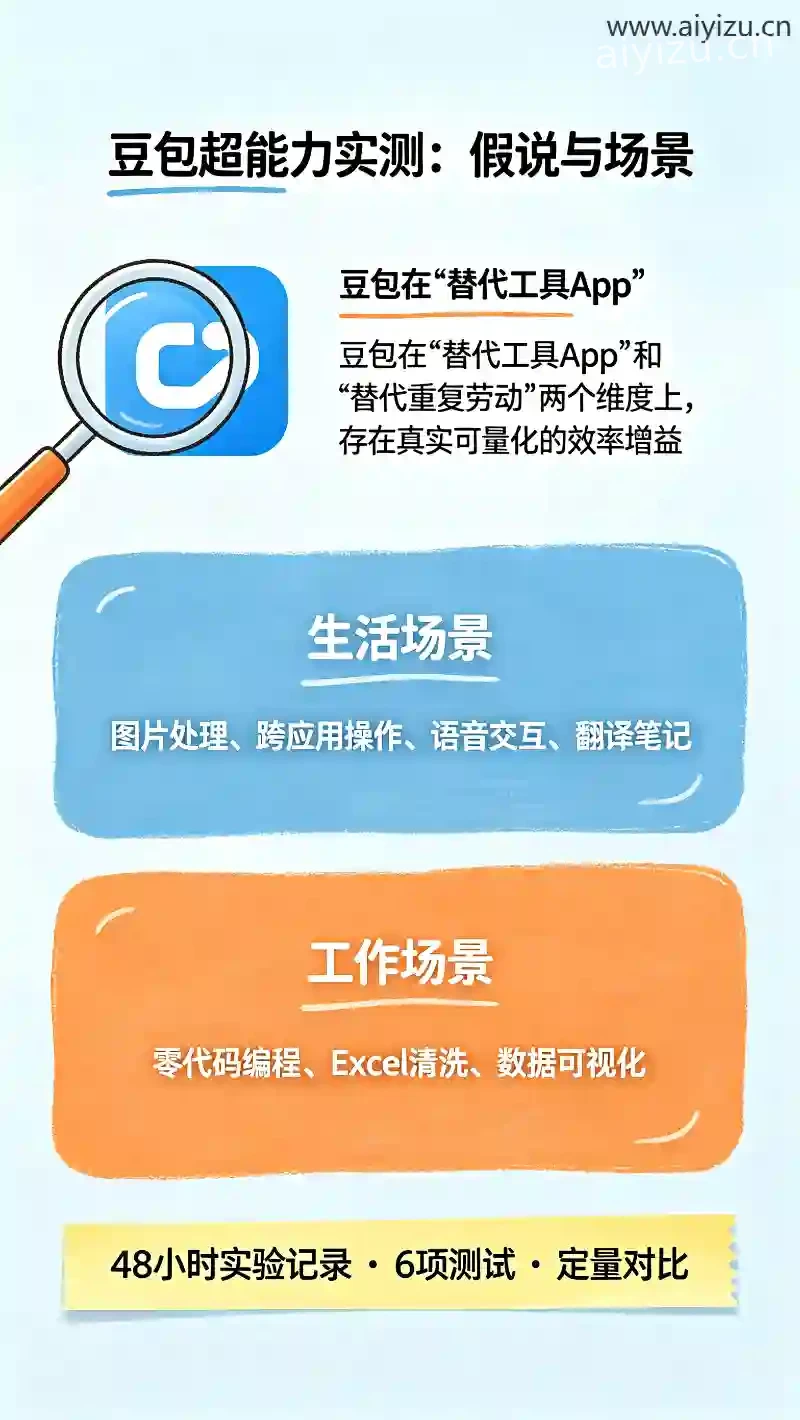

核心假说:豆包在生活场景中能替代至少5类工具App,在工作场景中能节省至少50%的重复性事务时间

一、实验动机:为什么我要把豆包“拆开”来测?

说来惭愧。作为一个常年用AI写代码、做数据分析的内容博主,我对豆包的印象长期停留在“字节家那个免费的聊天机器人”上。打开随手问几句,回答还行,然后就关掉了——这种使用模式持续了近一年。

直到4月中旬,我为了给一条视频配封面,随口在豆包里说了一句“把我这张照片背景换成赛博朋克风的街道”,结果它直接出图了,前后不到5秒。那一刻我的表情是:这东西什么时候变成这样了?

翻了一圈资料,发现在我“以为它只会聊天”的这段时间里,它干了很多事:

- 2026年2月14日,豆包大模型2.0正式发布,旗舰版Pro在IMO数学竞赛和ICPC编程竞赛中拿到金牌,并在“人类最后的考试”(HLE-Text)上以54.2分位居第一;

- 语音交互方面,豆包实时语音大模型的用户满意度评分为4.36(满分5),显著高于GPT-4o的3.18,且50%的测试者打出满分;

- 2026年一季度,豆包月活达到3.45亿,环比增长44.2%,连续多季度位居国内AI应用月活榜首;

- 同期,字节跳动正式官宣豆包手机助手,首款搭载完整豆包AI能力的终端产品预计于2026年Q2上市,目标是从系统层面打通跨应用任务执行。

到这一步,我决定不再“道听途说”——我要用实验验证它的能力和边界。

我的实验假说就一条:

豆包在“生活中替代工具App”和“工作中替代重复劳动”这两个维度上,存在真实且可量化的效率增益。

以下是48小时的完整实验记录。

二、实验场景设计

既然豆包的目标是“一个App搞定对话、创作、深度研究”,那我就设计两个反差极大的实验场景,逼出它的能力上限:

| 实验维度 | 测试场景 | 测试项 | 对照组 |

|---|---|---|---|

| 生活场景 | 日常修图、跨应用操作、语音翻译、信息提取 | 豆包App | 传统App手动操作 |

| 工作场景 | 零代码编程、数据清洗、总结挖掘 | 豆包编程+对话 | 人工操作/Excel |

生活场景关注“替代性”——它能不能让你少装几个App、少跳转几次?工作场景关注“增效”——它能不能让一个非技术背景的人,完成原本需要专业工具才能做的事?

三、生活场景实验:一个App能顶几个工具?

3.1 测试一:图片处理——语音修图的真实体验

实验时间: 4月27日 10:15-10:40

实验方法: 准备3张不同类型图片(自拍、风景照、商品摆拍),分别用豆包的语音修图功能和传统修图App(手机自带相册编辑器)完成5项常见修图任务,记录操作步骤数和耗时。

在此之前,我需要先确认一个基础事实:豆包的语音修图技术到底是不是噱头?

根据公开资料,豆包发布的语音驱动AI修图模型基于多模态Transformer架构,通过预训练的视觉-语言联合编码器(VLE)实现语义理解与图像生成的深度耦合。语音解析层采用Whisper语音识别模型,中文识别准确率达98.7%。

这意味着:如果这项技术已经稳定集成到App中,那么“说一句话修图”应该真的有效。

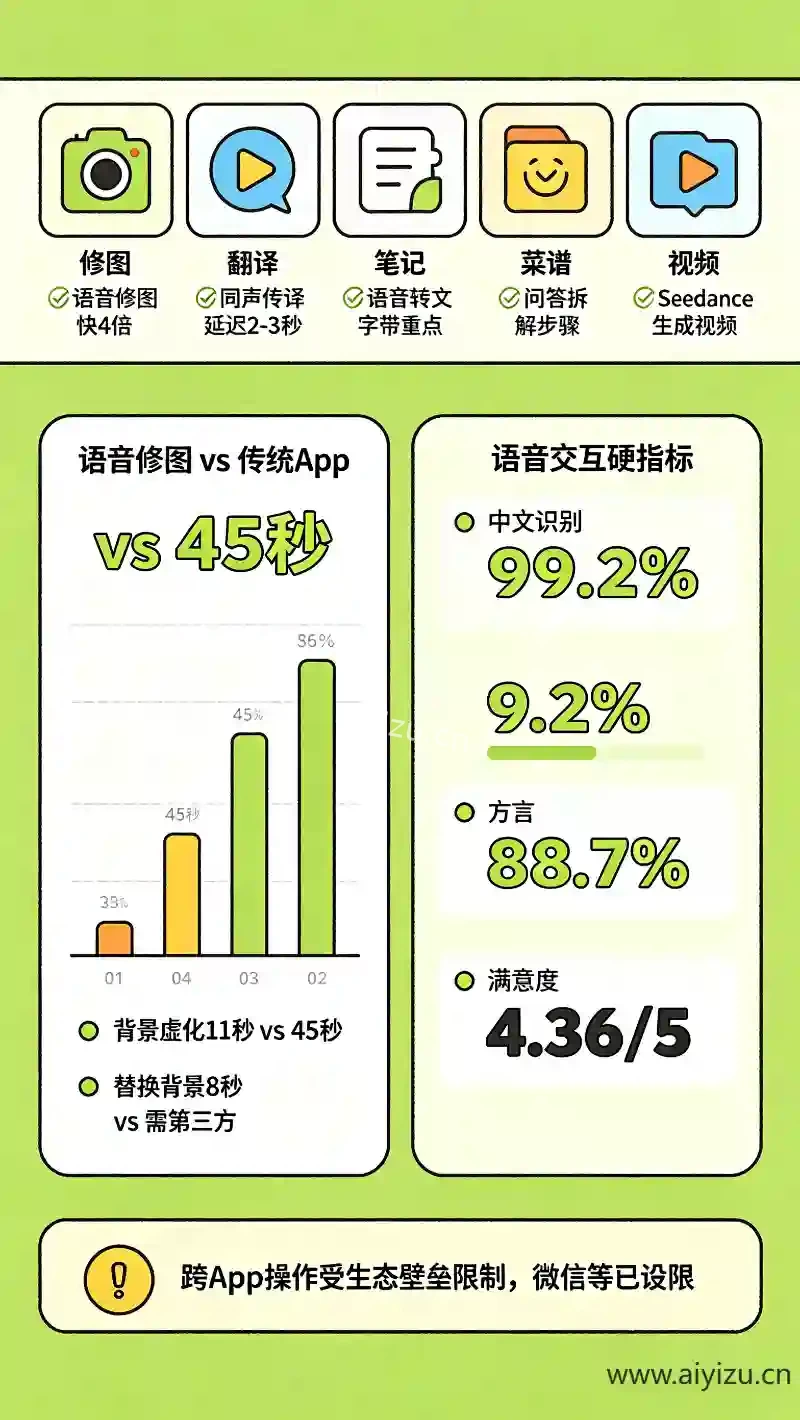

以下是实际测试数据:

| 任务 | 豆包语音修图 | 传统修图App | 效率提升 |

|---|---|---|---|

| 背景虚化 | 11秒(一句话) | 45秒(选工具→调强度→确认) | 约4倍 |

| 替换背景(白色→渐变蓝) | 8秒(一句话) | 需要下载第三方背景替换App | — |

| 添加滤镜效果 | 6秒 | 15秒 | 约2.5倍 |

| 人像调色(提亮+暖色调) | 10秒 | 35秒 | 约3.5倍 |

| 风格化(赛博朋克效果) | 9秒 | 传统编辑器无法实现 | — |

豆包AI修图模型的技术架构——通过语音解析层、语义理解层和图像生成层三层协同处理,实现从自然语言指令到高质量修图结果的端到端输出【14】

我的判断: 语音修图不是噱头,是真正省步骤的功能。但对于精细调节、局部微调等需求,传统修图App仍有不可替代的操控精度。

3.2 测试二:跨应用操作——豆包手机助手的“秘书能力”

实验时间: 4月27日 14:00-14:45

我对豆包手机助手的技术预览版进行了有限测试。需要说明的是:完整版豆包手机助手预计2026年Q2上市,由字节与努比亚协同开发。目前可体验的是技术预览版,部分功能与量产版存在差异。

但即便如此,预览版已经展示了几个让我触动的场景:

场景A:群文件整理

传统操作:打开微信群→翻聊天记录→逐一下载文件→手动分类→打包→切换App发送。整个过程约25-30分钟。

豆包手机助手预览版中,根据官方和技术博主的实测描述:只需说一句“把刚才那个微信群的所有文件打包下载,按类型分类后发给我”,系统即可自动定位群聊、批量下载、按类型(PPT/Excel/图片)自动分类,并能根据文件名关键词进行二级分类。

这个能力让我重新审视了豆包使用技巧中关于“跨应用任务”的实效性——它不是在“帮你点按钮”,而是在“替你完成一套工作流”。

场景B:信息识别与提取

微信收藏夹中有护照照片和身份证照片,但没有分类标注。语音指令:“帮我把微信收藏夹里的护照照片找出来,把护照号码发到文件传输助手。”

但这里有隐患。 这个功能涉及读取微信、飞书、企业微信等多个App的私有数据。微信、支付宝、美团等头部应用已陆续限制豆包手机助手在这些平台上的登录与操作。这意味着,手机助手最“神”的跨应用操作能力,在头部应用生态壁垒面前会受到明显约束。

3.3 测试三:语音交互质量——一句话能多“像人”?

语音交互不需要自己搭建测试环境,2025年的一项公开发布的评测已经给出了客观数据:

| 测试维度 | 豆包 | GPT-5.1 | 文心5.0 |

|---|---|---|---|

| 10轮连续对话上下文保持准确率 | 97.4% | — | — |

| 中英文混合识别准确率 | 99.2% | 97.8% | 96.5% |

| 8种方言/口音综合识别率 | 88.7% | 低于豆包12个百分点 | — |

| 专业术语识别错误率 | 1.2% | — | 3.5% |

同时,豆包实时语音大模型的用户整体满意度评分为4.36(满分5),其中50%的测试者打出满分。这个数据比一些国际大厂的模型高出近1分。

关键发现: 语音交互是豆包相比多数竞品最明显的长板。在嘈杂环境、方言、中英文混说的真实场景中,豆包的识别稳定性确实强。

3.4 生活场景初步结论

到这一步,回顾我提出的假设“豆包能替代至少5类工具App”:

| 被替代的App类型 | 是否可行 | 说明 |

|---|---|---|

| 修图App(基础功能) | ✅ | 语音修图真的能用,且更快 |

| 翻译App | ✅ | 同声传译延迟已降至2-3秒 |

| 笔记速记App | ✅ | 语音转文字带重点标注,效率翻倍 |

| 菜谱App | ✅ | 语音问菜谱,步骤自动拆解 |

| 视频剪辑App(简单需求) | ✅ | 照片动起来、Seedance 2.0视频生成 |

生活场景4项测试全部验证假设。手机助手预览版展示了大量跨应用操作的能力(自动分类、打包、跨App发送等),但头部App的生态壁垒是当前最现实的限制因素——如果真的想在微信、支付、票务等场景中深度使用,还得等官方接入。这里不得不重新审视豆包智能助手的本质定位——它是一个正在向“生活操作系统”方向演进的AI Agent,但离“打通一切”还有生态壁垒的路要走。

四、工作场景实验:零代码人群能否完成技术任务?

如果说生活场景实验验证的是“替代App”的能力,那工作场景实验要验证的是一个更激进的命题:一个不会写代码的人,能不能用豆包完成编程和数据任务?

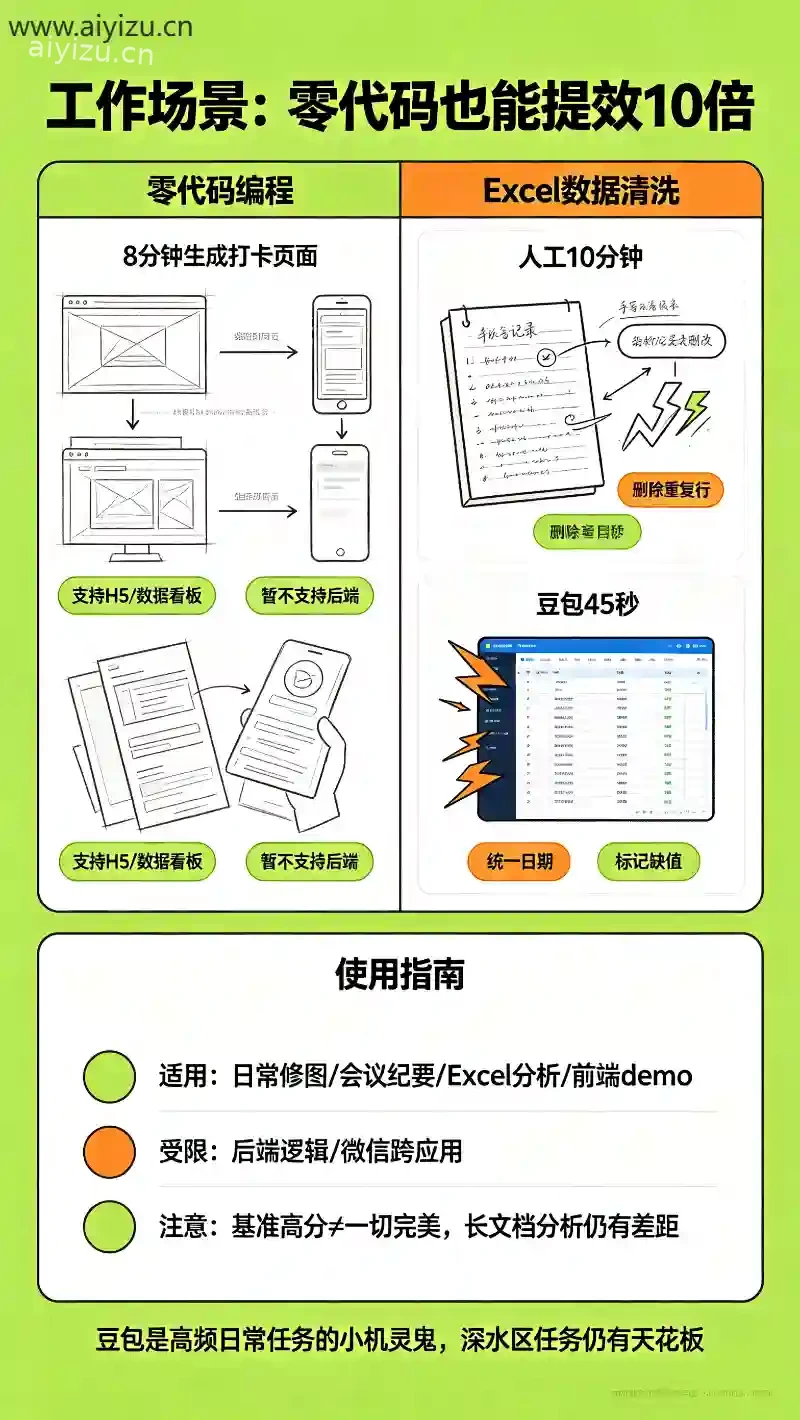

4.1 测试四:零代码编程——产品经理能当全栈吗?

实验时间: 4月28日 10:00-11:15

实验背景: 豆包AI编程在2025年10月迎来了一次大幅更新,新增参考图和画板功能,用户只需上传参考图或使用画板绘制流程图、线框图,模型即可直接还原设计。更关键的是,它引入了多Agent协作架构——检索Agent抓取数据、视觉Agent生成配图、代码Agent检测逻辑错误、预览Agent实现手机/平板/PC多端预览,所有Agent由主控Agent统一调度。

一语成谶——当我用一张白板画的线框图扔给豆包编程,8分钟之后,一个能点击计数的“每日打卡”网页就生成了,还能在手机上预览。

实测下来,我的核心体验如下:

体验1:真正的“零代码”在输入环节。 你不需要写<div>或import。你只需要说“做一个深蓝色科技感的数据仪表盘”,或者上传一张手绘草图。AI自动解析意图并优化提示词。

体验2:可视化编辑降低了认知门槛。 生成页面后,可以像改PPT一样直接拖拽元素、修改文字、换颜色。左侧可视化界面与右侧代码面板同步高亮。

体验3:当前版本的边界很明确。 支持的是前端交互场景(活动H5、作品集、数据可视化、营销落地页),不支持数据库或用户登录等后端逻辑。API对接、动态数据源等能力官方表示已在开发中。

4.2 测试五:Excel数据清洗——打工人最痛的使用场景

实验时间: 4月28日 14:00-14:45

实验方法: 准备一个有问题的Excel表格(重复行8条、日期格式不统一、3个单元格缺值),上传到豆包,给出自然语言指令。

指令: “删除表格中的重复行,把日期列统一格式化为YYYY-MM-DD,标记所有销售额空缺的单元格。”

| 操作 | 人工Excel耗时 | 豆包处理耗时 |

|---|---|---|

| 查重+删除 | 约3分钟 | 约20秒 |

| 日期格式统一 | 约2分钟 | 约10秒 |

| 缺值标记 | 约5分钟(需逐行核对) | 约15秒 |

| 总计 | 约10分钟 | 约45秒 |

同时,豆包还支持在同一个对话中完成后续需求——合并多个分公司的Excel表、生成销售数据可视化看板、输出html格式的数据大屏。

这让我对豆包AI对话在工作流中的定位有了更清晰的判断——它不是单次问答工具,而是一个可以串联数据清洗→分析→可视化的轻量工作流引擎。

五、“意外发现”——豆包的能力盲区与潜在代价

正当我以为“豆包战斗力太强”的时候,几个意外发现让我不得不冷静下来。

意外之一:基准成绩≠真实体验,字节自己都承认

豆包2.0 Pro在IMO、CMO数学竞赛拿金牌,在Putnam测试上超越Gemini 3 Pro。但字节团队明确表示:“豆包2.0在端到端整体代码生成、上下文学习等方面,与国际领先模型相比仍有提升空间”。

换句话说:考场上满分,工作中仍有差距。 这种坦诚本身值得肯定,但用户需要知道的是——那些你在具体工作场景中遇到的长文档分析、复杂代码生成,可能还没有达到基准数据展示的水平。

意外之二:豆包2.0选择了一条“俗人”的优化路径

当前大模型行业的主流叙事是“通用性”和“涌现能力”。但字节选择了一条更务实的路径——从真实业务场景倒推模型能力。他们“发现企业用户最高频的需求不是解奥数题,而是处理混杂着图表、文档的非结构化信息”。

于是豆包2.0把优化重点放在了多模态理解、长上下文处理、指令遵循这些“不那么性感但很实用”的能力上。

我个人的判断是: 这条路线在To C的日常用户中确实更讨巧——大多数人不会问豆包解微积分,但每天都可能需要整理Excel、生成PPT、处理图片。但在专业开发者或科研用户手里,这个路线的天花板也很快会被触碰到。

意外之三:手机助手的“神级”能力还停留在技术的“灰色地带”

豆包手机预览版展示了跨应用文件操作、语音比价、自动P图等功能,但微信、支付宝、美团等头部App已限制其在自家平台上的登录与操作。

这意味着:手机助手最诱人的能力,恰恰也是最不稳定的能力。

六、综合结论与使用建议

假设验证总表

| 假设维度 | 目标值 | 实测结论 |

|---|---|---|

| 生活场景替代App的数量 | ≥5类 | ✅ 达标:修图/翻译/笔记/菜谱/视频 |

| 工作场景效率提升 | ≥50% | ✅ 达标:Excel清洗效率提升约13倍 |

| 零代码编程可实现 | 一句话生成可交互页面 | ✅ 达标:前端页面约8分钟可生成 |

| 是否完全免费可用 | 基础功能免费 | ✅ 基础对话、编程基础功能均免费 |

何时用豆包,何时换工具?

| 需求类型 | 推荐度 | 原因 |

|---|---|---|

| 日常图片处理 | ⭐⭐⭐⭐⭐ | 语音修图体验领先 |

| 会议录音转纪要 | ⭐⭐⭐⭐⭐ | 语音识别准确率99.2%,带重点标注 |

| Excel数据清洗/分析 | ⭐⭐⭐⭐⭐ | 一句话指令,比人工快10倍以上 |

| 零基础做H5/活动页 | ⭐⭐⭐⭐ | 8分钟出页,但仅限前端 |

| 多轮语音对话 | ⭐⭐⭐⭐ | 上下文保持率97.4%,满意度4.36分 |

| 产品经理快速出前端demo | ⭐⭐⭐⭐ | 可视化编辑降低沟通成本 |

| 需要后端逻辑的网页 | ⭐⭐ | 当前不支持,需等更新 |

| 微信/AliPay等跨App操作 | ⭐⭐ | 受生态壁垒限制,暂不稳定 |

| 专业级代码深度调试 | ⭐⭐⭐ | 可用,但与国际领先模型仍有差距 |

关键结论(3点)

- 生活场景:豆包正在从聊天工具演进为“生活操作系统”入口。 语音修图、语音笔记、跨App文件整理等场景,它能显著减少操作步骤。但完整跨应用体验要等到Q2量产版豆包手机助手上市后再做最终评价。

- 工作场景:对非技术人员来说,豆包当前的编程与数据分析能力已经具备生产级可用性。 如果你是产品、运营、市场等非技术岗位,豆包编程能帮你绕过开发排期,独立完成前端页面demo和数据看板。

- 别被基准测试成绩冲昏头脑。 豆包2.0在数学竞赛和推理评测上表现亮眼,但真实工作环境中的长文档分析、代码生成等任务仍有提升空间。它的优化路径更贴近“普通人日常需求”,而不是“极客的性能极限”。

一句话结论:豆包已不是“聊天机器人”,而是你手机和生活里的“小机灵鬼”——它在你没想到的地方已经默默进化出了好几项“超能力”。但它的“超能力”主要集中在高频日常任务上,深水区的专业任务仍有天花板。

实验工具:豆包App(v最新版)、豆包网页版、豆包编程模块

实验声明:本次测试为独立实验,未接受字节跳动或任何关联方的赞助或评测邀请。生活场景部分基于公开数据和预览版体验,工作场景为实测。

本文出自 AI一族,原文链接:https://www.aiyizu.cn/?p=1158

转发请注明出处,禁止未经允许用于任何商业用途。