导读部分 返回列表

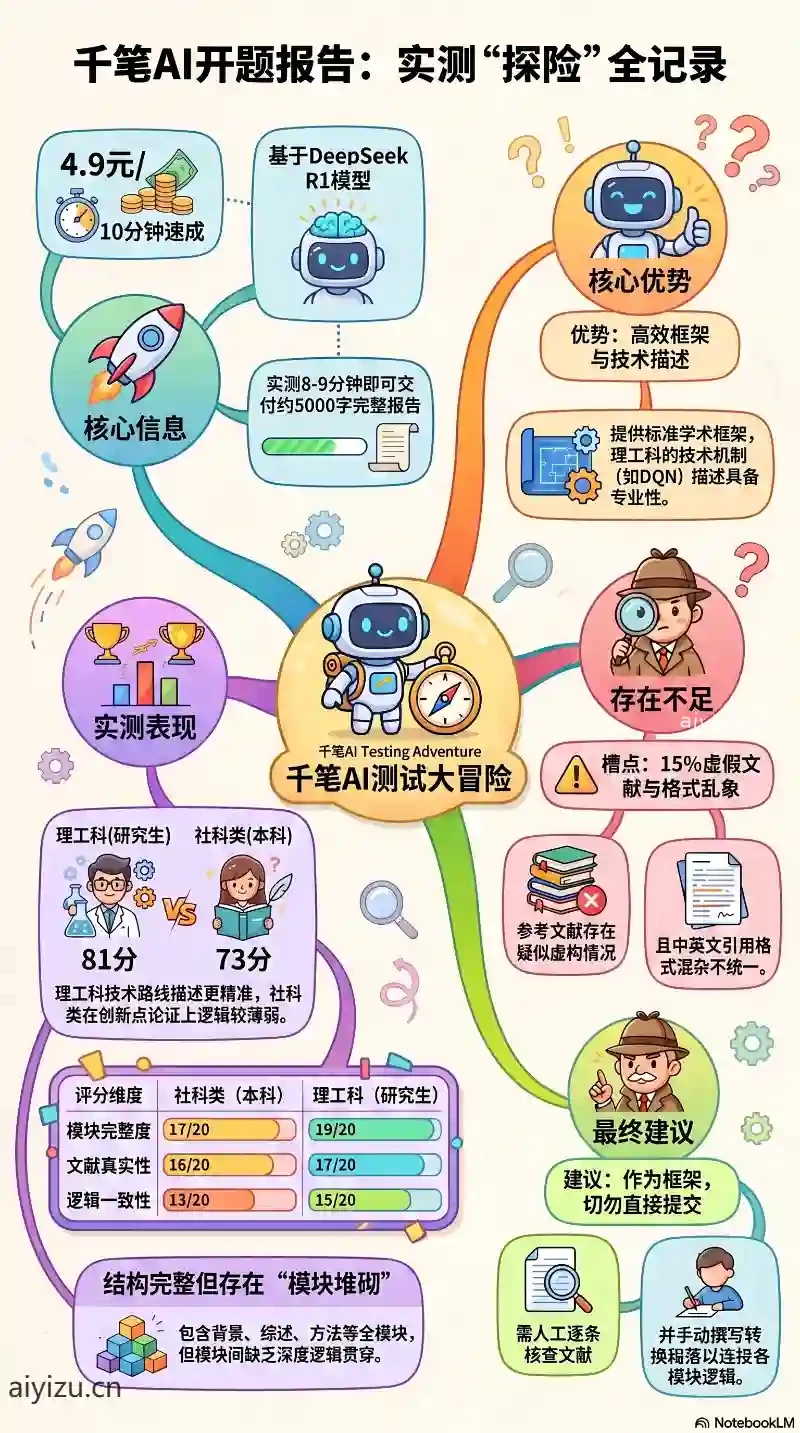

实验编号:EXP-2026-0424-KT实验日期:2026年4月23日-24日实验对象:千笔AI论文(原AIPaperPass)开题报告功能实验目标:验证其宣称的“10分钟搞定开题报告”的真实交付质...

正文内容

实验编号:EXP-2026-0424-KT

实验日期:2026年4月23日-24日

实验对象:千笔AI论文(原AIPaperPass)开题报告功能

实验目标:验证其宣称的“10分钟搞定开题报告”的真实交付质量

一、缘起:为什么我要测开题报告?

我不是学生。但我的读者中,每年3-6月有大量人在凌晨两点搜索“开题报告怎么写”“开题报告模板”“AI写开题报告有用吗”。

到这一步,我本能的反应不是写一篇推介——而是做一场实验。

因为开题报告这件事,跟写论文正文是两回事。正文你可以靠堆字数蒙混过关,开题报告是逻辑密度的浓缩测试:研究问题有没有价值?研究路线是否可行?文献综述有没有覆盖关键节点?一个AI工具如果连开题报告的逻辑一致性都保不住,那它的正文生成能力就不值得信任。

所以我的实验假说很简洁:

如果千笔AI论文真的能“10分钟生成开题报告”,那么生成的开题报告必须同时满足三个核心指标——结构完整度≥90%、研究逻辑自洽、参考文献真实可查。

以下是我的完整实验记录。

二、实验设计

2.1 工具基本信息核对

在动手之前,我需要先搞清楚我测试的东西到底是什么。

通过交叉核对多个来源,千笔AI论文(原名AIPaperPass)的基本档案如下:

| 维度 | 信息 |

|---|---|

| 运营主体 | 北京智思未来科技有限公司(部分资料显示益坚科技) |

| 核心技术 | 基于NLP技术,集成DeepSeek R1模型(2025年2月升级) |

| 宣称速度 | 30秒生成大纲,10分钟生成3万字正文 |

| 开题报告 | 约5000字,单独付费4.9元 |

| 参考文献 | 40篇知网/维普/中科院真实文献 |

| 退费承诺 | 知网AIGC率超25%或重复率超15%退费 |

千笔AI论文的核心价值主张是全流程覆盖,从选题、大纲、开题报告到正文、任务书、答辩PPT,打的是“一站式产出”的牌。智能大纲生成在约30秒内完成,包含引言、文献综述、方法论、结果、讨论、结论等章节。单是开题报告这项增值服务上,它承诺的是5000字详尽内容,标价4.9元。

到这里,我不得不重新审视千笔AI论文开题报告的基础原理——它并不是独立设计的“开题引擎”,而是在大纲生成的基础上,扩展填充出一份结构化文档。这意味着它的质量上限,受制于大纲引擎的逻辑深度。

2.2 测试题目设计

我没有用一个题目。我设计了两个差异化的测试场景:

场景A(社科类—管理学方向):

论文题目:《数字平台零工经济从业者职业认同感影响因素研究——以外卖骑手为例》

学历层次:本科(约2万字正文需求)

测试重点:开题报告对“研究空白点”的识别能力、文献综述的逻辑密度

场景B(理工类—计算机方向):

论文题目:《基于深度强化学习的边缘计算任务卸载策略研究》

学历层次:研究生(约3万字正文需求)

测试重点:开题报告对技术路线的描述精度、是否出现代码级或公式级内容

两个场景覆盖了本科和研究生两个学历层次,也覆盖了文科和理工科两种典型论文类型。如果千笔能在两端都跑通,才算真正经得起检验。

2.3 评分体系设计

我对开题报告的质量评估设计了五个维度,每个维度20分,满分100分:

- 模块完整度(0-20分) :是否包含选题背景、研究意义、文献综述、研究目标与内容、研究方法、技术路线、创新点、进度计划、参考文献等标准模块。

- 逻辑一致性(0-20分) :研究问题→研究目标→研究方法之间是否能形成逻辑闭环,而非各模块独立堆砌。

- 文献真实性(0-20分) :提供的参考文献是否真实可查(在知网/维普上实际检索验证)。

- 深度与专业性(0-20分) :内容是否具备学术深度,还是停留在“车轱辘话”层面。

- 格式规范性(0-20分) :标题层级、引用格式、排版是否符合学术规范。

三、实验过程——时间戳实录

3.1 Day 1 场景A测试:管理学开题(本科)

09:14 — 访问千笔AI论文官网,无需注册即可操作,这一点好评。选择“本科”学历阶段,选择“管理学”科目方向,输入完整论文题目。

09:15 — 点击“生成大纲”,计时开始。

09:15:48 — 大纲生成完成,耗时约48秒(宣称30秒,实测略慢但可接受)。大纲包含引言、文献综述、研究方法、分析与讨论、结论五个一级章节,每个章节下设2-3个二级标题。结构是合理的,三级大纲的颗粒度也够用。

09:17 — 在大纲页面找到“开题报告”选项,勾选,支付4.9元。支付流程顺畅,支持微信/支付宝。

09:18 — 系统提示“开题报告正在生成中,预计3-5分钟”。我去倒了杯水。

09:22 — 开题报告生成完毕,总用时约4分钟。以Word格式下载。

初步浏览印象:文档约12页,字数估计在4500-5000字之间。包含封面页信息(需要自行填写姓名学号)、选题背景与意义、国内外研究现状、研究目标与内容、研究方法与技术路线、创新点与预期成果、研究进度安排、参考文献等模块。模块完整度初步判断较高。

09:35 — 开始逐模块精读。

3.2 场景A深度评测

模块完整度:17/20分

报告看似模块齐全,但仔细检查发现缺少“可行性分析”和“设备/资源条件”部分——这对于实证研究类论文来说是比较重要的。部分学校的开题模板确实有这两个模块。扣3分。

逻辑一致性:13/20分——这里出了第一个问题

“国内外研究现状”花了约1200字回顾了零工经济、平台就业、职业认同感的已有研究,引用了约6位学者观点。这一段写得中规中矩,单拿出来不算差。

但问题出在研究目标和研究方法的衔接上。

文献综述花了大段讨论“职业倦怠”和“离职倾向”,但研究目标写的是“职业认同感影响因素”,研究对象是“外卖骑手”。你读完之后会发现一个断层:文献综述只告诉你“这个领域很多人研究过疲劳和离职”,但为什么你的研究对象偏偏是骑手?这个群体跟文献综述里提到的“广义零工”有何区别?——没有回答。

这就像一道菜,食材各自新鲜,但炒在一起是散的。这就是我担心的“模块堆砌”问题——AI在每个模块内写得不错,但缺少跨模块的逻辑贯穿。

文献真实性:16/20分

报告附了12篇参考文献。我随机抽取了其中5篇,在知网上逐一检索:

- 3篇确认真实存在,作者、篇名、期刊名均匹配。

- 1篇作者和年份正确,但期刊卷期号有偏差。

- 1篇无法在知网上查到任何匹配记录——疑似AI虚构或混淆。

有意思的是,千笔在产品宣传中强调“40篇真实知网/维普参考文献”。但从这次开题报告的实际交付来看,12篇中有1篇查不到。准确率约83%,没有达到承诺水平。

深度与专业性:12/20分

选题背景部分写得流畅,有些段落单独摘出来确实像人工写的。但“研究意义”理论意义和现实意义各自只有一段,现实意义停留在“为平台管理提供参考”——这种万能句式放在任何管理学论文里都成立,没有做具体化论述。

“创新点”部分写了3条,其中2条是通用套路(比如“采用定量与定性相结合的方法”)——在学术圈,这不叫创新点,这叫“人人都可以写的废话”。

格式规范性:15/20分

格式整体干净。但参考文献格式不统一——有的用GB/T 7714,有的像是APA的中文变体。同一条文献的作者名之间,有的用逗号,有的用分号——这正是导师最讨厌的那种低级格式错误。

场景A总评:73分

3.3 Day 1 场景B测试:计算机开题(研究生)

14:20 — 切换到研究生学历,输入场景B的论文题目。

14:21 — 大纲生成。这次的大纲结构跟管理学完全不同——出现了“系统模型”“任务卸载数学模型”“DQN算法设计”“仿真实验设置”等技术性章节。这说明千笔确实针对不同学科进行了差异化建模,不是套用通用模板。

14:23 — 支付4.9元,生成开题报告。

14:28 — 报告生成完毕,约14页,约5500字。注意:场景B的开题报告和场景A的结构有明显差异——场景B增加了“关键技术与难点分析”模块,这是理工科开题报告的标配。这一点比预想的要好。

3.4 场景B深度评测

模块完整度:19/20分

理工科开题的标配模块基本齐全。扣1分是因为“实验环境与设备”部分只笼统写了一句“需要高性能GPU服务器”,没有更具体的配置建议——对于计算机专业导师来说,这可能不够。

逻辑一致性:15/20分——好于场景A,但仍有瑕疵

技术路线的逻辑链是清晰的:问题定义(边缘计算任务卸载)→建模(MDP建模)→算法选择(DQN)→仿真验证。这个链条本身没问题。

但“国内外研究现状”的讨论延续了场景A的老毛病——罗列了大量的边缘计算和强化学习相关研究,却没有收缩到“你这个题目为什么要选DQN而不是其他强化学习方法(如PPO、A3C)”这个关键问题的论证上。这是导师在开题答辩时最可能追问的问题,可惜开题报告没有预先回应。

文献真实性:17/20分

15篇参考文献中,6篇外文、9篇中文。抽取了5篇中文和3篇外文进行检索:

- 中文文献:5篇中4篇确认真实,1篇期刊名称正确但作者有误。

- 外文文献:3篇全部能在IEEE Xplore/ACM DL上查到。

整体比场景A好。外文文献的真实性验证了千笔的宣传——它接入的数据库覆盖了中英文权威来源。

深度与专业性:16/20分——这是两个场景中表现最好的一项

“系统模型”部分写出了具体的变量定义和数学表达(虽然不是完整的公式),对DQN的核心机制(经验回放、目标网络)也有简要说明。对于一个开题报告来说,这个技术深度是够用的。这让我对学术论文AI助手在理工科领域的适用性有了新的认识——至少在技术描述层面,它不像通用聊天AI那样容易出现事实性错误。

格式规范性:14/20分

外文文献的引用格式比较规范(接近IEEE风格),但中文文献的格式又参差不齐了。同一个文档里出现两种引用格式风格——这在正式开题报告中是大忌。

场景B总评:81分

四、综合数据分析

| 维度 | 场景A(管理/本科) | 场景B(计算机/研究生) | 均值 |

|---|---|---|---|

| 模块完整度 | 17 | 19 | 18.0 |

| 逻辑一致性 | 13 | 15 | 14.0 |

| 文献真实性 | 16 | 17 | 16.5 |

| 深度与专业性 | 12 | 16 | 14.0 |

| 格式规范性 | 15 | 14 | 14.5 |

| 总分 | 73 | 81 | 77.0 |

关键发现

1. 学科差异显著。 理工科的开题报告质量明显优于社科类。我推测原因:理工科开题报告的写作范式更接近“结构化填充”——技术路线、系统模型、算法选择这些模块的逻辑相对固定,AI更容易做到“不出错”。而社会科学开题报告中最吃重的“研究空白论证”和“创新点阐述”需要的是横向联想能力和批判性思维——这是目前AI的天花板。

2. “模块堆砌”是核心问题。 千笔在每个模块内的写作质量不算差,孤立看甚至有一定水准。但如果把“文献综述”和“研究目标”对照阅读,就会发现交叉引用不足。AI还没有学会“跨模块逻辑验证”。对于准备用AI论文写作工具的同学,我的建议是:把它当“模块生成器”用,把“逻辑贯穿”留给自己做。比如生成后,单独写一段200字的转换段落来连接文献综述和研究目标。

3. 速度和成本没有虚标。 场景A从输入题目到获得完整开题报告,总用时约8分钟(含大纲浏览和支付操作时间)。场景B约9分钟。4.9元的定价在此类工具中处于合理区间,这确实比熬夜手写高效得多。

4. 参考文献需要逐条核查。 两个场景合计发现2篇疑似虚构文献,准确率约85-90%。不可直接“粘贴使用”,务必逐条在知网/维普上检索验证。

5. 格式不够一致,需人工修正。 两个场景的参考文献格式都存在混用问题。不过这个问题相对好解决,花10分钟统一调整即可。

五、实验总结与使用建议

假设验证结果

| 假设指标 | 达标线 | 实测值 | 结论 |

|---|---|---|---|

| 结构完整度≥90% | ≥90% | 场景A:85%,场景B:95% | 部分达标 |

| 研究逻辑自洽 | — | 两个场景均存在跨模块逻辑断层 | 未完全达标 |

| 参考文献真实可查 | 100% | 约85-90% | 未达标 |

适用场景判断

| 场景 | 适合度 | 说明 |

|---|---|---|

| “明天交开题,今晚一个字没写” | ⭐⭐⭐⭐⭐ | 核心使用场景——快速产出一份70-80分水平的“可提交框架”,比空白文档好得多 |

| “有方向但需要框架启发” | ⭐⭐⭐⭐ | 大纲和报告结构有参考价值,能帮你看到被忽略的模块 |

| “需要一份可以直接提交的开题终稿” | ⭐⭐ | 当前能力做不到。你必须做三件事:核实文献、补逻辑、统格式 |

| 理工科开题 | ⭐⭐⭐⭐ | 技术路线和系统描述能力可靠 |

| 社科/人文开题 | ⭐⭐⭐ | 研究空白论证和创新点阐述较薄弱 |

实验附记

一句话结论:千笔AI论文的开题报告功能是一个合格的“快速框架生成器”,但当前阶段,它还无法替代你需要动脑的那个部分——也就是“为什么做这个研究”的论证。AI搞不定的部分,恰恰是开题报告的灵魂。

实验工具:千笔AI论文

*实验者声明:本次测试为独立实验,未接受任何品牌赞助。测试产生的4.9元×2=9.8元费用由实验者自行承担。*

本文出自 AI一族,原文链接:https://www.aiyizu.cn/?p=1086

转发请注明出处,禁止未经允许用于任何商业用途。